Alexa, Siri und Assistant - der Mitarbeiter hört mit

Die Zeitarbeitsfirma Randstad in Polen suchte per Anzeige Mitarbeiter für die Auswertung von Alexa-Sprachaufnahmen – soweit, so normal. Dabei bewarb sie die Jobs allerdings mit “Telearbeit im ganzen Land”. Der Auftraggeber war Amazon. Wie die Welt am Sonntag berichtete, hörten die Mitarbeiter die Aufnahmen außerhalb der kontrollierten Geschäftsräume des Unternehmens ab. Konkret spricht die Welt von den privaten Wohnungen. Das ist deswegen problematisch, weil die Aufnahmen teils höchst persönliche oder gar intime Informationen enthalten. Gelegentlich sei eine eindeutige Identifikation der Personen möglich, durch genannte Namen oder Orte. Aus Sicht des Datenschutzes müsste eigentlich unbedingt verhindert werden, dass nicht angestellte Personen die Aufnahmen hören könnten.

Gegenüber der Welt am Sonntag bezeichnete einer der polnischen Mitarbeiter die Arbeit als “ideale Hausfrauentätigkeit”. Viele Kollegen kombinierten den Job mit der Kinderbetreuung zu Hause. Die entsprechenden Job-Anzeigen sind mittlerweile verschwunden. Gesucht wurden polnische Mitarbeiterinnen und Mitarbeiter mit Deutschkenntnissen auf Muttersprachniveau.

Dass Menschen die Aufnahmen von Alexa anhören, war bereits bekannt: Zwar erkennen die Algorithmen der Sprachassistenten einen Großteil der gesprochenen Sprache; um das System aber weiter anzulernen, müssen einige Aufnahmen von Menschen transkribiert werden. Bislang hatte Amazon beteuert, dass dies nur in geschützten Büros mit Zutrittsbeschränkungen passiere. Die Recherche der Welt hat diese Behauptung widerlegt.

Abhören abschalten

Amazon reagierte bereits auf die Kritik: Ein Sprecher sagte, dass es einigen Mitarbeitern gestattet sei, von anderen Orten aus zu arbeiten. “Dabei gelten strenge Sicherheitsmaßnahmen und Richtlinien, an die sich jeder Mitarbeiter halten muss.” Die Arbeit an öffentlichen Orten sei nicht erlaubt.

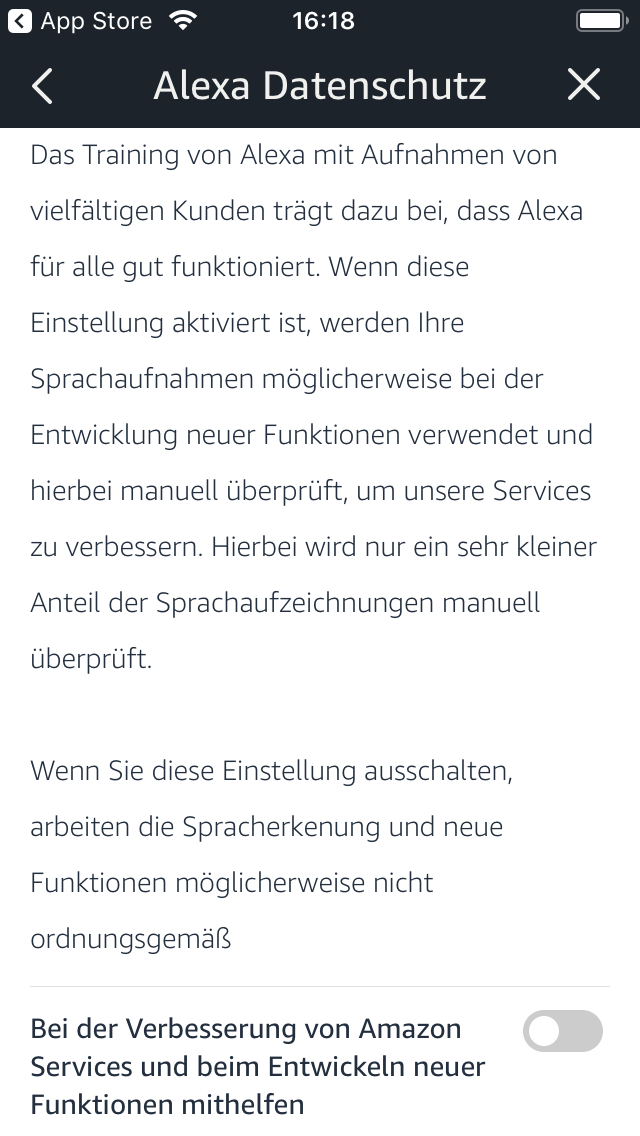

Zudem hat Amazon in die Alexa-App einen Schalter eingebaut, der verhindert, dass Mitarbeiter die Aufnahmen anhören. Den Schalter finden Sie in der Alexa-App unter “Einstellungen→Alexa Datenschutz→Legen Sie fest, wie Ihre Daten Alexa verbessern sollen”. Sowohl die Bezeichnung des Menüpunktes als auch die Erklärungen rund um den Schalter sind recht verklausuliert. Dort heißt es unkonkret, dass die Sprachaufnahmen möglicherweise “manuell überprüft” werden. “Hierbei wird nur ein sehr kleiner Anteil der Sprachaufnahmen manuell überprüft.” Des Weiteren wird bei Ändern der Einstellung davor gewarnt, dass Spracherkennung und neue Funktionen möglicherweise nicht ordnungsgemäß arbeiten. Wieso dies der Fall sein sollte, ist unklar. Schließlich dürfte die Überprüfung der Sprachaufnahmen keinen direkten Einfluss auf die aktuelle Funktionsfähigkeit von Alexa haben. Stattdessen dient die Datenanalyse nur dazu, neue Funktionen zu entwickeln oder Alexas Reaktionsqualität in Zukunft zu verbessern.

Google und Apple kaum besser

Anfang August wurde der Sprachassistent Google Assistant aus ähnlichen Gründen kritisiert wie nun Amazon: Hamburgs Datenschutzbeauftragter Johannes Caspar hat ein Verwaltungsverfahren gegen den Konzern eingeleitet wegen möglicher systematischer Verletzung der Privatsphäre und Verletzung der Datenschutzgrundverordnung (DSGVO). Grund für Caspars Reaktion waren durch niederländische Whistleblower veröffentlichte Aufnahmen, die teils sensible personenbezogene Informationen enthielten. Außerdem entstanden viele Aufnahmen wegen fehlerhafter Erkennung des Aktivierungsbegriffs.

Google hat daraufhin das Abhören der Aufnahmen bis Ende Oktober EU-weit ausgesetzt. Wie es danach weitergeht, ist unklar. Für mehr als drei Monate kann Caspar die Praxis sowieso nicht unterbinden, denn anschließend ist die irische Datenschutzbehörde für Google zuständig. Als weitere Reaktion veröffentlichte Google einen (englischsprachigen) Blog-Eintrag, in dem die Firma ihr Handeln erklärt. Sie verspricht den Nutzern besser zu erklären, wofür die Aufnahmen verwendet werden und zukünftige Leaks dieser Art zu verhindern.

Wie die britische Zeitung The Guardian Ende Juli aufdeckte, gibt auch Apple die von Siri aufgezeichneten Audiodaten an Drittfirmen weiter. Die Argumentation des Konzerns ist die gleiche wie bei den Konkurrenten: Die Auswertung soll dem Sprachassistenten helfen, den Nutzer besser zu verstehen und Fehlerkennungen zu minimieren.

Gegenüber des Technik-Blogs Techcrunch kündigte Apple an, das Überprüfungsverfahren vorerst weltweit einzustellen und den Nutzern zukünftig die Wahl zu lassen, ob ihre Aufnahmen verwendet werden dürfen.

In Apples Fall besteht das Problem weniger darin, dass Menschen die Aufnahmen anhören. Das Problem liegt vielmehr darin, dass der Konzern seine Partnerfirmen nicht nennt und es für den Konsumenten somit schwer nachzuvollziehen ist, wo seine Daten letztendlich landen. Apple versichert gegenüber dem Guardian: “Siri Reaktionen werden in sicheren Einrichtungen analysiert und alle Gutachter sind in der Verpflichtung Apples strenge Vertraulichkeitsanforderungen einzuhalten.” Auf diese Weise würden 1 Prozent der Aufnahmen analysiert.

Ein anonymer Whistleblower, der für Apple oder seine Partnerfirmen arbeitet, sagte dem Guardian, dass er mit einer Vielzahl versehentlicher Aufnahmen zu tun habe. Er oder sie hätte zahllose (“countless”) private Konversationen mitbekommen: Ärzte, die mit ihren Patienten Diagnosen besprechen, Geschäftsgespräche, kriminelle Geschäftsgespräche und sexuelle Begegnungen. Die Apple Watch und der smarte Lautsprecher HomePod seien die häufigsten Quellen für versehentlich ausgelöste Aufnahmen. Laut der Quelle würden zu den Aufnahmen Nutzerdaten wie Standorte, Kontaktdaten und App-Daten geliefert werden. Obwohl Apple in seinen Dokumenten davon spricht, dass die Siri-Daten nicht mit den Informationen der anderen hauseigenen Dienste verknüpft würden.

Aufnahmen löschen

Wer nicht auf die Sprachassistenten verzichten und dennoch ein klein wenig mehr Kontrolle über seine Daten möchte, kann die gespeicherten Sprachdaten bei Google und Amazon löschen. Bei Ersterem kann man die Aufnahmen hier entweder manuell entfernen oder eine Automatik einstellen. Amazon erlaubt hier unter “Alexa-Datenschutz” nur die manuelle Löschung, so dass man regelmäßig aktiv werden muss. Apple bietet bislang keine vergeichbare Möglichkeit, kündigte aber an, eine solche Funktion per Update nachzuliefern. (hcz)