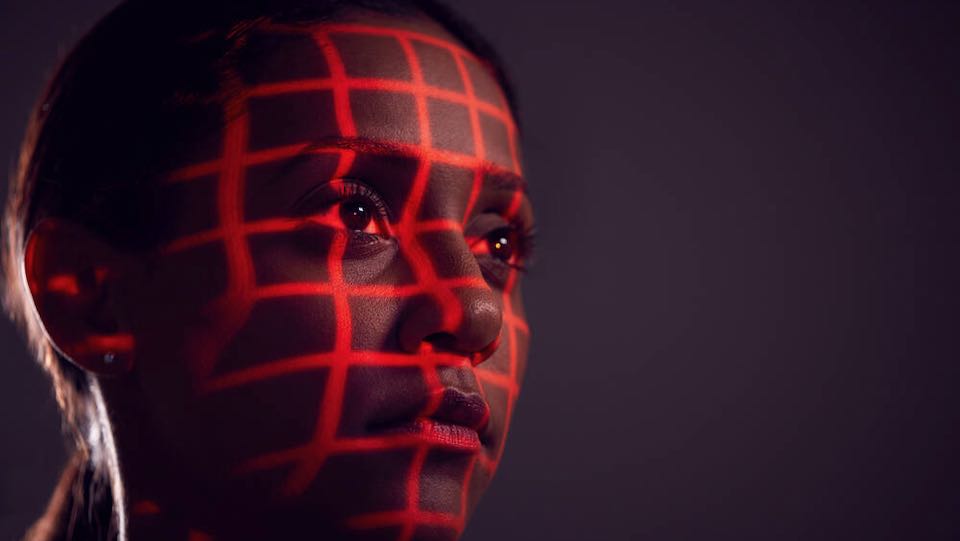

Sicherheitsbedenken: Microsoft streicht Emotionserkennung

Der Software-Konzern Microsoft wird einige Funktionen aus seiner KI-gestützten Gesichtserkennungssoftware entfernen. Unter anderem soll das System künftig nicht mehr in der Lage sein, auf Basis von Gesichtsscans Emotionen zu analysieren. Das Potenzial des Missbrauchs sei zu groß, urteilt der Konzern.

Gleiches gelte für die automatisierte Erkennung des Geschlechts, Alters, Lächelns, der Gesichts- und Kopfbehaarung und von Make-up. Die Analyse dieser Attribute “eröffnet auch eine Vielzahl von Möglichkeiten, wie sie missbraucht werden können”, erklärt die Microsoft-Produkt-Managerin Sarah Bird in einem Blog-Eintrag. Mögliche Gefahren seien Stereotypisierung, Diskriminierung oder ungerechtfertigte Verweigerung von Dienstleistungen.

Die Emotionserkennung werfe zudem Fragen zum Datenschutz, einer allgemein gültigen Definition von Emotionen und “der Unmöglichkeit auf, die Verbindung zwischen Gesichtsausdruck und emotionalem Zustand über Anwendungsfälle, Regionen und demografische Merkmale hinweg zu verallgemeinern”. Darauf hätten Experten innerhalb und außerhalb des Unternehmens hingewiesen. Allein bei der Definition von Emotionen mangele es an wissenschaftlichem Konsens.

Dieses Problem bestehe nicht nur bei der Gesichtserkennung, sondern bei allen KI-Systemen, die emotionale Zustände analysieren sollen. Deshalb werde die Firma alle Programme dieser Art nun überprüfen.

Neue Richtlinien für KI-Entwicklung

Die genannten Funktionen stehen Neukunden der Microsoft-Produkte Azure Face API, Computer Vision und Video Indexer seit dem 21. Juni 2022 nicht mehr zur Verfügung. Bestandskunden können sie noch bis zum 30. Juni 2023 einsetzen. Eine Ausnahme macht Microsoft für Projekte und Programme zur Unterstützung von behinderten Menschen. Hier werden die KI-Erkennungssysteme weiter nutzbar sein.

Die Änderungen im Umgang mit der Gesichtserkennung erfolgen im Rahmen neuer firmeninterner Regeln im Umgang mit künstlicher Intelligenz. In einem Blog-Eintrag vom Dienstag stellte die “Hauptverantwortliche KI-Beauftragte” Natasha Crampton die Eckpunkte des neuen Regelwerks vor.

Der neue “Responsible AI Standard” legt Zielvorgaben fest in den Bereichen Rechenschaft, Transparenz, Fairness, Zuverlässigkeit, Datenschutz und Inklusion, an denen sich die Microsoft-Entwickler orientieren müssen.

Beschränkter Zugriff

Neukunden, die Microsofts Gesichtserkennung – ohne Emotionsanalyse und ähnliches – einsetzen möchten, müssen den Zugriff nun beantragen und angeben, zu welchen Zwecken die Gesichtserkennung eingesetzt werden soll. Bestandskunden können die Technik vorerst weiter verwenden. Innerhalb eines Jahres müssen aber auch sie bei Microsoft eine Genehmigung einholen und ihre Anwendungsfälle darlegen. Durch die Überprüfung wolle der Konzern sicherstellen, dass der Einsatz der Technologie einen “hohen Nutzen für die Nutzerinnen und Nutzer und die Gesellschaft” hat.

Einige automatisierte Erkennungsfunktionen bleiben aber auch ohne Genehmigung einsetzbar: Dazu gehören unter anderem Erkennung von Unschärfe, Belichtung, Brille und Kopfhaltung.

EU-Gesetz in der Entwicklung

In der Stellungnahme übt Microsoft auch Kritik an bestehenden Gesetzen beim Thema KI – und sieht sich in der Vorreiterrolle: “KI wird immer mehr zu einem Teil unseres Lebens, und doch hinken unsere Gesetze hinterher. Sie haben die einzigartigen Risiken der KI oder die Bedürfnisse der Gesellschaft nicht eingeholt.”

Das Europaparlament hatte sich im Oktober 2021 gegen Massenüberwachung mittels automatisierter Gesichtserkennung und anderer biometrischer Erkennungsverfahren ausgesprochen und eine entsprechende Resolution verabschiedet. Die Abgeordneten wollten damit die EU-Kommission auffordern, die finanzielle Förderung solcher Technologien zu stoppen – und KI-unterstützte Systeme im öffentlichen Raum zu verbieten.

Das Parlament hatte damit der bisherigen Richtung von EU-Kommission und EU-Ratspräsidentschaft widersprochen. Die Kommission hatte im April 2021 einen Verordnungsentwurf für den Einsatz von künstlicher Intelligenz vorgestellt. Dieser sah zwar vor, sogenannte Hochrisiko-Anwendungen stärker zu regulieren, doch für biometrische Echtzeit-Überwachung war eine Vielzahl von Ausnahmen enthalten, bei denen Gesichtserkennung erlaubt bliebe. (hcz)